2025年,浸溺在人工智能(AI)生成内容中的泥泞之年。

之所以如此形容,可以看看全球多个词典选取的年度词汇。《柯林斯词典》最先发布 “vibe coding”(氛围编码:使用AI生成计算机代码),英国《剑桥词典》选中了“parasocial”(准社交:人们与虚构角色或网络公众人物的情感联系和互动,对象甚至可以是AI聊天机器人)。

美国《韦氏词典》、澳大利亚《麦格瑞词典》和英国《经济学人》杂志不约而同选择了“slop”作为年度词汇。

Slop是指“通常由人工智能(AI)批量生成的低质量数字内容”。韦氏出版公司表示,“slop”一词带有黏稠、不洁的语感,可以“无孔不入”。在18世纪,该词原意为“软泥”,19世纪时演变为像“猪食”这样的食物残渣。多数媒体将其翻译成“AI泥浆”,并进一步把讨论范围扩展到“信息泥浆”。

聊天机器人DeepSeek列举的“信息泥浆”特征包括:大量重复、模糊、未经核实或浅薄的信息堆积在一起,看似内容丰富,实则有效知识密度极低;往往通过算法推荐、社交传播等方式不断粘住用户,消耗其时间和注意力,却难以产生实际价值,就像在泥浆中挣扎,越用力越疲惫;常包含强烈情绪色彩(如煽动性言论、片面观点),容易引发本能反应而非理性思考,加剧认知偏见。韦氏称,当下“slop” 带来的情绪不是恐慌,而是蔑视。

这一年,AI巨浪依然奔涌澎湃,大语言模型的机器行为越来越接近人类。今年早些时候,美国加州大学圣地亚哥分校的研究组在预印本平台arXiv.org上发表论文,首次系统性证明了一个机器智能系统通过三元图灵测试,其中GPT-4.5 PERSONA模式的胜率显著高于50%,意味着人类已经分辨不出它是机器。

在AI的加持下,人们提升了即时任务的质量和效率,也为之付出了代价。哈佛大学5月的研究发现,生成式AI提高了生产力,但使用者的内在动力被削弱。麻省理工学院媒体实验室发布的预审论文指出,ChatGPT可能正在侵蚀批判性思维能力,发育中的大脑风险最高。

这些AI系统会成为人类友善的助手来提高生产力,还是让人丧失思考和创造力的“垃圾制造器”?原本我们可以通过调整AI的使用方式来自主选择,而数字环境的剧变增加了被动接受的机会。调查显示,即使是2岁以下的婴儿也难逃一劫,因为早教中的数字内容也被“污染”。

经由AI生成的荒诞而无意义的视频、图像和文字加速喷涌,“堵塞”了屏幕。AI生成内容何以变成Slop,它如何重塑生活,我们又该怎样与之共生?

技术迭代给垃圾信息装上超级引擎

今年3月,成千上万张“吉卜力风”的仿制图像突然间传遍全网,无数人将社交媒体账户的头像换成了吉卜力风图片,包括AI开发机构OpenAI的首席执行官山姆·奥特曼。在一波“吉卜力化”的模仿潮中,许多极不符合宫崎骏电影宇宙的场景出现,比如一个“吉卜力版”的特朗普在一次未遂刺杀后高举拳头;一架“吉卜力风”的飞机撞上双子塔。

吉卜力工作室的创始人宫崎骏是公开的AI技术反对者,他在2016年的一次活动中看到AI动画演示后表示:“这是对生命本身的侮辱。”

这股潮流中最荒诞的时刻出现在白宫官方X账号——一张经过吉卜力滤镜处理的照片,画面中是一名哭泣着被捕的涉毒罪犯。

3月19日,白宫发布图片,配文称一名因贩卖芬太尼而被驱逐出境的外籍重罪犯,非法重新进入美国后在费城被捕。

这一切正是拜GPT-4o所赐,它是OpenAI在3月更新的模型,生成图像的逼真度远高于以往版本。奥特曼称,GPT-4o带来的需求之大,几乎让公司的服务器“熔化”。

X上的一条热门帖欢呼:“艺术变得触手可及了。”配图是一张多人合影被转换成3种不同的艺术视觉风格。评论区出现了激烈的争论,针对AI仿图是否能被称为艺术,意见极度对立。

德国学者瓦尔特·本雅明在1933年的文章《机械复制时代的艺术作品》中写道:“原作的在场性,是‘真实性’概念的前提。” 因此有观点认为,相比担心艺术家的处境,更担心的应该是观众,他们或许会满足于如此之多苍白的仿制品。

AI给原有的垃圾信息装上了超级引擎,迅速引向了视频领域。在过去一年里,AI视频生产链条的每一个环节都展现出了惊人的进步,成倍放大了视频创作者的生产能力和效率。

有美媒举了个例子,一名创作者可以先用ChatGPT构思视频创意和对白,再用Midjourney生成画面,用 ElevenLabs合成逼真的配音,最后通过OpenAI的Sora、Meta的Movie Gen,或一些规模较小的新兴工具(如Hailuo、Luma或Kling)把所有内容整合并动画化。

“一年前,AI视频还只是勉强可以,用起来并不顺手,刚刚起步。”追踪视频趋势的AI工具Post Cheetah的联合创始人马克·加达拉-玛丽亚对媒体表示,“而今天,它几乎与现实难以区分。”

这一转变导致大量AI视频涌入网络。有调查分析发现,今年5月,10个订阅增长最快的YouTube频道中有4个涉及AI视频。

谷歌5月发布其最新AI视频生成器Veo 3,可输出高清画质,并具备为每个场景生成音效的能力,成为AI生成视频领域的一大突破。该工具可对任何照片动画化,变成逼真的8秒短片。而且,谷歌还将Veo 3与YouTube打通,意味着又多了一种便捷通道,把AI视频以及潜在的“AI垃圾”直接灌入社交媒体。

4个月后,OpenAI推出视频生成模型Sora 2.0,同步上线全新视频应用Sora,用户可以根据文字提示生成短视频,还能创建一个逼真的AI虚拟形象和声音,嵌入自己或其他人的视频中,这成为制作深伪(deepfake)视频最简单的方式之一。

Sora应用于10月在美国和加拿大以邀请制形式上线,仅5天就突破了100万次下载,超过了ChatGPT的首发。如此流行的一个重要原因是,Sora允许使用名人、运动员和政治家的肖像,前提是他们已经去世,如果是在世名人需征得他们同意。

一时间,Sora的主信息流成了一个超现实的漩涡,充斥着“脑腐”(注:指长期沉浸在低质量、强刺激、无思考价值的信息中,导致注意力、判断力和思考能力退化的状态。)内容,比如阿道夫·希特勒在一则洗发水广告里用手拨弄着一头油亮的长发;伊丽莎白二世女王从酒吧桌子上弹射而起;马丁·路德·金则在加油站里对店员讲述他有一个梦想——有一天所有的冰沙饮料都免费,话还没说完拿起冰饮就跑。

这些搞笑视频充斥平台,被“二创”的历史人物的亲属却笑不出来,美国非裔民权运动人士马尔科姆·X的女儿伊利亚萨·沙巴兹在接受媒体采访时表示,父亲遇刺时她只有两岁,如今Sora生成的视频中却出现了他父亲与马丁·路德·金“摔跤”以及讲粗俗笑话等情节,“这让我感到深深的不敬与伤害”。

在社交平台充斥AI生成内容之际,Meta首席执行官马克·扎克伯格更为直接:9月宣布推出Vibes短视频平台,平台内所有内容都是AI生成的。用户可以使用Meta AI助手将生成的图片制作成动画或编辑视频。

Vibes上线不久,“商业内幕”网站随即以“我们从Meta的Vibes频道获得了新鲜的AI垃圾。谢谢扎克!”为题发文抨击,称网上的普遍共识是:Meta投入数亿美元雇佣AI尖端人才,却制造了一个无用的AI垃圾源。

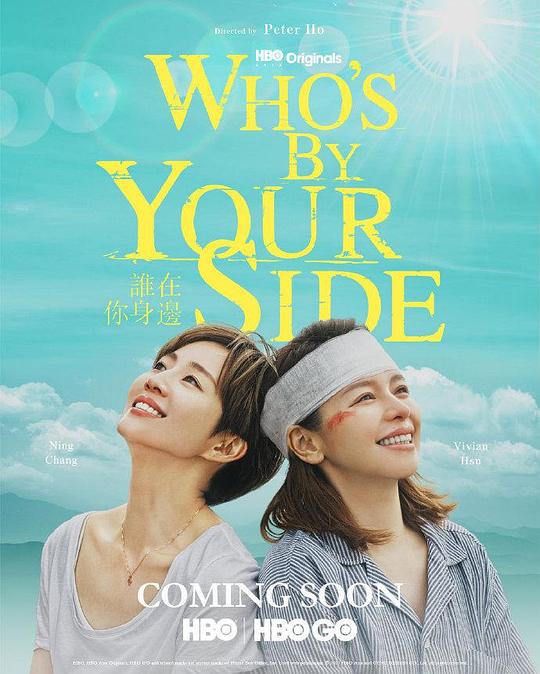

除了视频,还有AI音乐。一个名为Velvet Sundown的摇滚乐队6月连发两张专辑,其中一首摇滚民谣《Dust on the Wind》表达了对和平的支持,当月底在英国、挪威和瑞典的Spotify每日“Viral 50”榜单中夺冠。首张专辑收获了百万听众,然而乐队很快自曝他们是由AI创造,“不完全是人类,不完全是机器,而是在两者之间”。

Velvet Sundown的专辑页面

艺术家和业界呼吁标记或禁止像Velvet Sundown这样的AI乐队,《卫报》援引多名专业人士的观点指出,目前流媒体网站没有法律义务识别AI生成音乐,导致消费者对所听歌曲的来源一无所知。

建立完善的法律规制至关重要,但禁止AI乐队绝非保护人类原创音乐的唯一途径,人们希望AI帮助艺术家,而非替代艺术家。

滚动生财链条

依赖于科技巨头免费或低价提供的工具,基于AI的图像、视频、音乐批量繁殖,引发了传统艺术家和创意传播者的存在主义恐慌,担心这些内容会挤压电影制作人、音乐人、记者和其他领域创作者的生存空间。无论影响如何,AI生成内容之势难以逆转,因为它的兴起不仅是科技使然,也有利益滚动。

《华盛顿邮报》称,典型的AI创作者赚到的第一笔钱,往往直接来自社交平台,也就是TikTok、YouTube和Instagram为奖励爆款内容而设立的各种激励计划,根据观看人数和广告曝光情况向创作者支付报酬。

AI视频已成为“互联网地下经济”中的高人气收入来源之一,部分大学生、全职妈妈以及失业人士靠写假新闻、运营垃圾账号打零工,就像开网约车一样。有些兼职者一天花2-3小时,每月能赚2000-3000美元。

来自美国佛罗里达州的一名学生展示了一张她的TikTok收益截图:一段由AI制作的网红“吃玻璃水果”的视频,发布4天内带来了886美元的收入。她已经暂停学业,创办了一个线上“AI爆款俱乐部”,向订阅者提供视频制作指南,每人每月收费29美元。

许多创作者都希望摆脱单纯靠爆款分成的盈利模式,转而向渴望入行的人出售AI工具课程和模板。甚至还有创作者出售“提示词包”(prompt drops),列出他们为生成某个场景而给AI输入的具体指令。创作者正在不断探索AI生成过程中每一个环节的潜在受益点。

当然,还有更大的交易。预测博彩公司Kalshi在NBA总决赛期间投放了一支电视广告,片中全是AI生成的人物。Kalshi发言人表示,这支视频的AI提示费用为2000美元,从构想到上线不到72小时,远比传统影视制作流程快得多。广告的创作者说,“高多巴胺”的AI视频将是 “2025年的广告趋势”。

创意和科技行业的一些从业者对于Sora和Vibes的出现感到失望,人工智能非营利组织 “公平训练”(Fairly Trained)的首席执行官、作曲家艾德·牛顿-雷克斯将Sora称为 “社交媒体和AI中最糟糕的东西”,“简直就是泔水,别无其他”。

奥特曼回应说,理解批评者的观点,但公司需要赚钱来负担数据中心的成本。他重申公司的使命是获得足够的计算能力治愈癌症并实现“通用人工智能(AGI)”。

讽刺的是,Sora 2模型本身就需要大量计算能力,这表明OpenAI需要利用计算能力来支持更多算力。Sora 2最初免费提供,功能限制相对宽松,想要解锁限制获得完整服务的用户需要支付每月200美元的ChatGPT Pro订阅费。

Meta尚未对Vibes视频流是否有助于其盈利发表评论,但在社交平台上,互动和广告收入是关键。据美国消费者与商业新闻频道(CNBC)报道,自9月底Vibes发布不到1个月的时间内,Meta AI应用在iOS和安卓上的下载量均同比增长56%,总下载量达到390万次。

“AI源源不断生成低质量内容,其核心目的就是击中算法。”独立科技新闻网站404 Media的联合创始人杰森·科布勒说,就像是抽中算法的彩票,让人点赞、评论、转发,然后爆红。

这个由原媒体集团Vice记者创立的网站曾发布报道称,其原创文章的AI “洗稿”版本出现在垃圾网站上,其中一些在谷歌搜索中的排名甚至高于原文。于是他们调查发现,有一款AI工具一键即可创建同一篇文章的1000个不同版本,通过付费插件可以自动发布到任意数量的WordPress网页,有效地从原创媒体窃取了高额点击量,进而将广告盈利收入囊中。

“垃圾食品”过量,反噬警告

低质量AI生成内容的传播过程往往被描述为,科技巨头利用算法强加给毫无防备的公众,或是无良商家为牟利生产垃圾信息。但或许也应该反思:为什么我们会如此容易接受低质量内容?

美国加州路德大学政治学教授何塞·马里查尔撰文指出,低质量内容可以被视为一种“被优化过的垃圾食品”:它满足我们对快捷、熟悉内容的渴望,迅速填补 “饥饿感”。而且,在多年暴露于算法推荐系统和平台资本主义之后,我们正逐渐失去对“异类(outliers)”的品味能力,不再把偏离算法模型的内容视为成长的机会。

AI Slop不仅限于文化娱乐领域,它已渗透进社会的方方面面。生成式AI在职场中的使用激增,但大多数公司并未看到可衡量的投资回报(ROI)。据《哈佛商业评论》9月报道,研究机构BetterUp Labs与斯坦福大学的研究发现,美国全职员工中有41%在一个月内收到过AI生成的工作内容,每一次几乎要花近两小时返工。它被称为“工作泥浆”(workslop)——一种伪装成精良成果的AI生成内容,但缺乏足以推进任务的实质性信息。

研究分析称,对一个万人规模的组织而言,“工作泥浆”按41%的发生率,一年将损失超过900万美元的生产力。同时,情绪与关系成本同样显著,53%的人感到恼火,38%感到困惑,22%觉得被冒犯。

这并非一个新出现的问题,“草台班子”一直存在,只是生成式AI让坏习惯规模化、并把成本转嫁给同事。研究者认为,高能动性+高乐观的“飞行员”型员工,更倾向于用AI增强创造力、达成目标;相对应,“乘客”型员工更可能用AI逃避工作。目的性决定质量。

如果政客可以被视为政治世界里的打工人,那么他们当中也有不少人热衷于AI生成内容,最终汇入泥潭之中。最鲜活的例子莫过于10月在“真实社交”平台上出现的一个视频,画面中美国总统特朗普头戴一顶王冠,驾驶着一架机身侧面印有“特朗普国王”字样的战斗机,向纽约时代广场上“No King”(不要国王)抗议者倾倒了一连串看起来像粪便的东西。这正是出自特朗普的官方账号,当天美国多个城市出现反特朗普集会。

《连线》杂志将上述视频形容为AI Slop,并警告总有一天会出现一段经过篡改,足以颠覆选举、引发股市崩盘或挑起战争的视频。“而目前正处于一个更加荒谬的阶段,白宫发布这些视频时根本没有任何策略,或许只是为了嘲讽和戏弄。”

在各行各业被AI Slop冲刷得一片狼藉时,最具讽刺意味的是,人工智能研究人员警告说,AI领域本身正被使用大型语言模型撰写的劣质学术论文所淹没。加州大学伯克利分校计算机科学教授哈尼·法里德12月初在接受《卫报》采访时,称这种现状“令人疯狂”。他提到,有AI研究员声称今年发表了113篇有关该领域的论文,简直是“一场灾难”。

法里德补充说,由于大量泛泛而谈之作涌入AI领域,他现在建议学生不要进入这一行,“你跟不上时代,发表不了论文,做不出好作品,也无法进行深入思考。”

尽管如此,AI带来的进步毋庸置疑,关键在于我们如何合理使用或与之合作,避免让AI泥浆浇得狼狈不堪。

泥浆中踩刹车与滑行

多项研究不断得出同样的结论:相比机器生成,人们更愿意选择人类创作的内容,即便一时分辨不出区别。

根据调查机构益普索8月发布的消费者追踪调查,约3/4的美国人希望新闻和娱乐内容由人类创作,2/3的美国人希望营销和艺术内容也由人类创作。

在中国,结论亦然。今年,由中国国家自然科学基金支持的研究《消费者对人类生成与人工智能生成艺术品的偏好》中,一项实地研究和3项实验室实验显示,消费者始终更偏爱人类创作的艺术作品,这种偏好源于消费者对AI生成的同理心降低,进而削弱了认同感。

于是,一些数字平台开始试探类似“紧急制动开关”的功能,让用户自己掌控暴露于AI内容的程度。据美国新闻网站Quartz 12月报道,TikTok正在测试一个AI内容开关滑块;Pinterest推出了一套反AI垃圾内容控制系统;YouTube要求创作者标注AI合成内容,尽管这些标签在二次上传后几乎都会消失;Instagram也在标记AI生成内容。

美国版贴吧Reddit的用户们依然保持着“老派”风格,用简单的文字评论交流兴趣、爱好和日常话题,版主们在几十个社区中直接封禁AI。Reddit首席执行官史蒂夫·霍夫曼今年5月接受媒体采访时表示,他押注用户的真实声音,能够在AI提供的“经过注释却冷冰冰的标准化答案”中脱颖而出。

社交平台上用户的对话信息,对训练AI机器人而言是宝贵的语料,而围绕AI数据抓取的合法边界尚不清晰,Reddit今年6月起诉美国人工智能公司Anthropic,指控其超过10万次爬取Reddit的服务器数据。

此前,一些图书作者已将Meta和Anthropic告上法庭,指控其AI模型侵犯版权,但近期接连败诉。而Reddit的诉讼并非基于版权侵权,而是针对不正当商业行为这一理由。Anthropic的一位发言人称,不同意上述指控,将坚决辩护。

有些平台在踩刹车,另一些则猛踩油门。普利策奖作为美国主流政治文化和新闻精神的产物,采取了一种温和滑行的应对,从2024年开始要求报送者披露作品是否使用了AI,是怎样使用的。

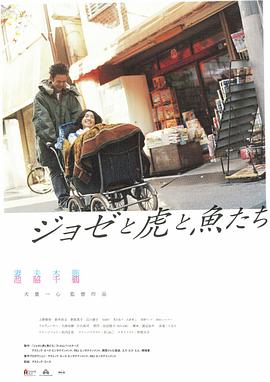

今年普利策评奖过程中,有一篇获奖作品和3篇入围作品向评审委员会披露了人工智能的使用情况,其中《华尔街日报》的一份关于埃隆·马斯克政治形象重塑的可视化报道获得国家报道奖,作者并未使用生成式人工智能模型,而是从谷歌的软件开发工具包(SDK)中调用了文本和图像嵌入模型,也就是用于生成向量的模型。报道作者之一约翰·韦斯特说:“图像嵌入模型如今已经非常强大,这在一年前是根本做不到的。”

2025年普利策获奖报道《通过马斯克本人约30万字言论,呈现他向政治领域的急转弯》的部分内容。《华尔街日报》网站截图

身处庞大信息流中的我们,既会遭遇AI垃圾,也会欣赏到如上述报道这样的AI助力作品。即使AI Slop是大势所趋,也无需绝望。专门从事开源调查的组织Bellingcat的高级调查员科琳娜·科尔泰说,人们很容易认为网上看到的一切都是假的,但这种偏见与一切信以为真一样危险,容易被不法者利用,进而混淆是非。

当提问ChatGPT“如何看待AI Slop”,它的一句话总结是:“AI Slop会淹没信息世界,但它也会让真正有价值的东西浮出水面。”